Aunque la IA tiene el potencial de transformar los procesos y hacer la síntesis más oportuna, asequible y sostenible, la tecnología es potencialmente disruptiva y conlleva riesgos como la opacidad, el sesgo algorítmico y la creación de contenido fabricado (alucinaciones).

Recientemente se ha desarrollado la guía RISE (Responsible use of AI in evidence SynthEsis) para abordar la necesidad de un consenso sobre qué constituye el uso responsable de los LLMs. Cochrane y JBI han adoptado una posición conjunta y oficial respecto al uso de la Inteligencia Artificial (IA) en la síntesis de evidencia, la cual está formalmente alineada con las recomendaciones RAISE (Responsible use of AI in evidence SynthEsis). Esta postura se estableció en colaboración con la Campbell Collaboration y la Collaboration for Environmental Evidence (CEE), formando un Grupo Conjunto de Métodos de IA (1).

¿Qué son los principios RAISE?

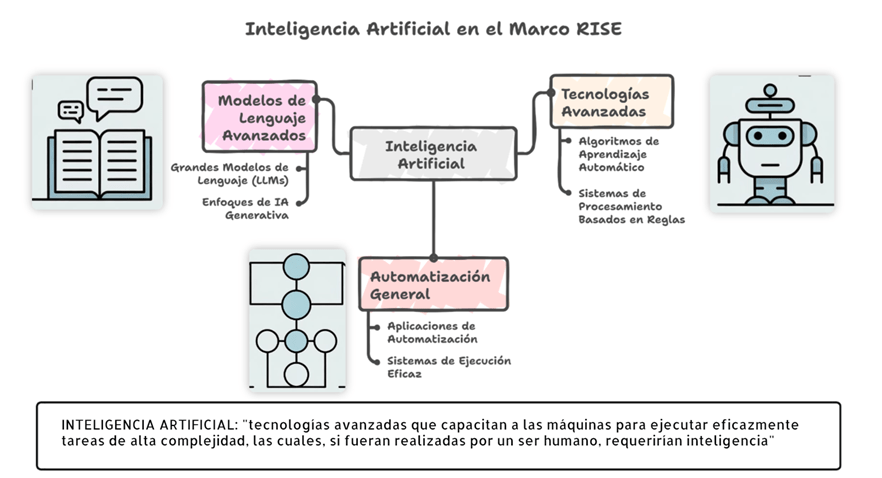

RISE establece un marco de trabajo para garantizar el uso responsable de la inteligencia artificial (IA) y la automatización a lo largo de todo el ecosistema de la síntesis de evidencia. Tiene como objetivo Salvaguardar los principios esenciales de la integridad de la investigación frente a la integración creciente de la IA (2).

Los autores podrán integrar la inteligencia artificial en sus procesos de síntesis de evidencia y preparación de manuscritos, siempre que se garantice que su uso no comprometerá el rigor metodológico ni la integridad de la evidencia sintetizada. Su implementación debe estar debidamente justificada y sustentada por la solidez metodológica de las herramientas empleadas.

Cómo se implementan las recomendaciones RISE

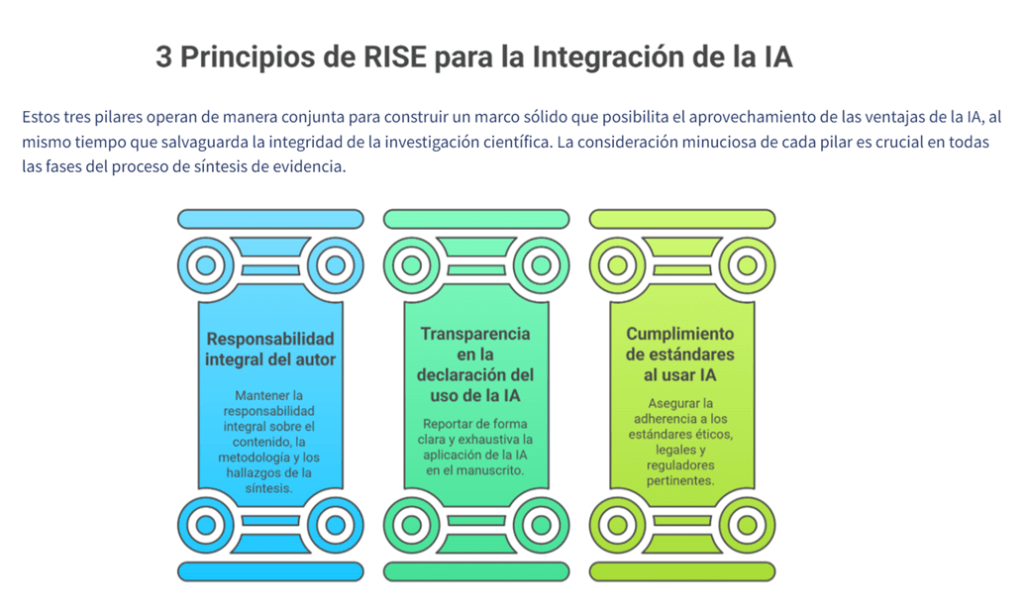

RISE establece tres categorías principales de recomendaciones para los autores de síntesis de evidencia:

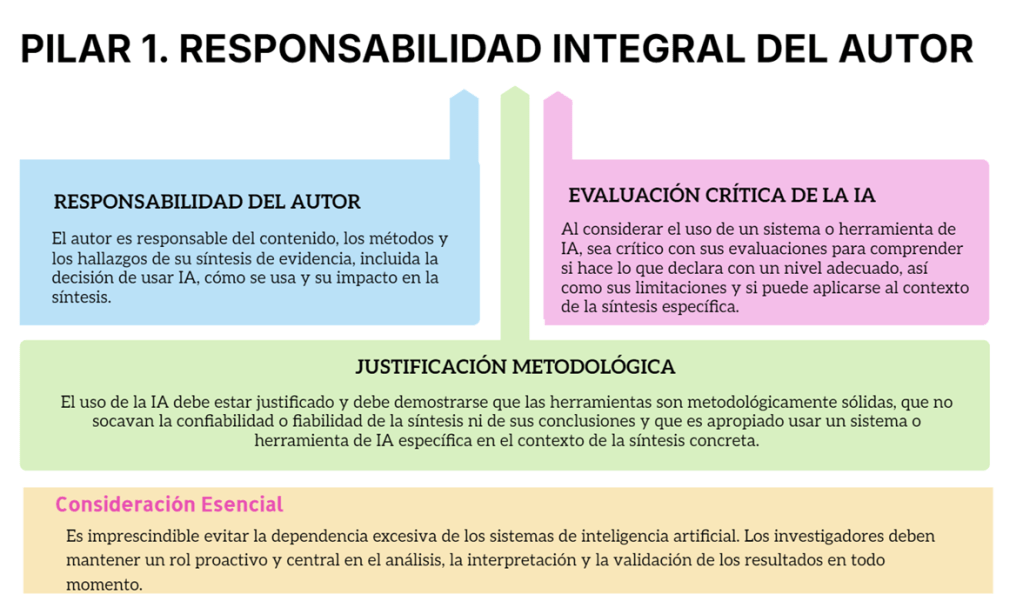

Pilar 1. Responsabilidad última: la firma es tuya.

El autor es el responsable final del contenido, los métodos y los hallazgos de su síntesis, incluyendo la decisión de usar la IA, cómo se emplea y el impacto que tiene en el resultado. El equipo autor responde del contenido, métodos y hallazgos, incluida la decisión de usar IA, cómo se usa y su impacto. Antes de adoptar herramientas, sé crítico: ¿hacen lo que prometen?, ¿con qué limitaciones?, ¿encajan con tu pregunta y contexto? Justifica el uso: demuestra solidez metodológica y que no compromete la confianza en resultados y conclusiones.

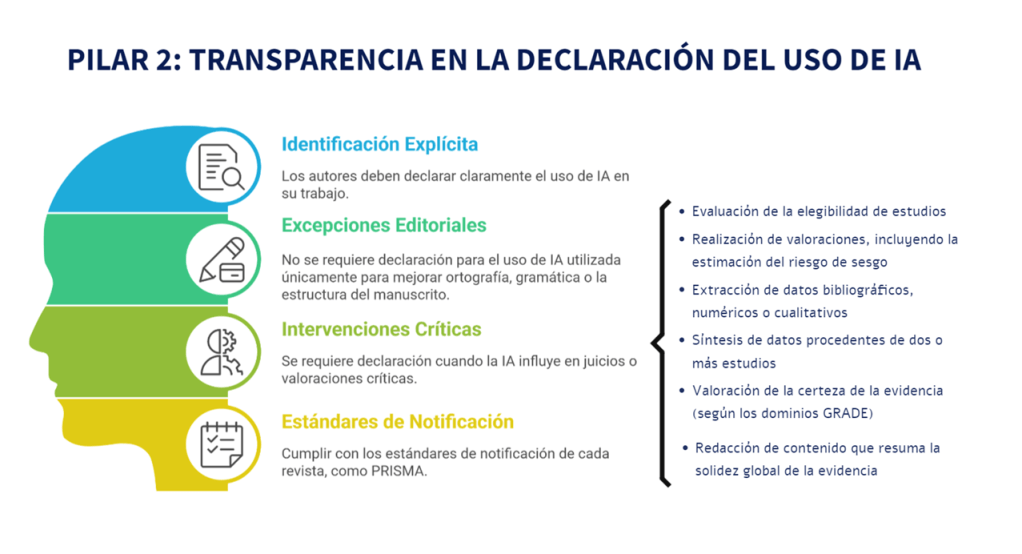

PILAR 2. Transparencia: cuéntalo (y cuéntalo bien).

Declara la IA cuando hace o sugiere juicios (elegibilidad, riesgo de sesgo, extracción, síntesis, GRADE, resúmenes). No suele ser necesario declarar correcciones menores de ortografía/gramática, salvo que la revista lo exija.

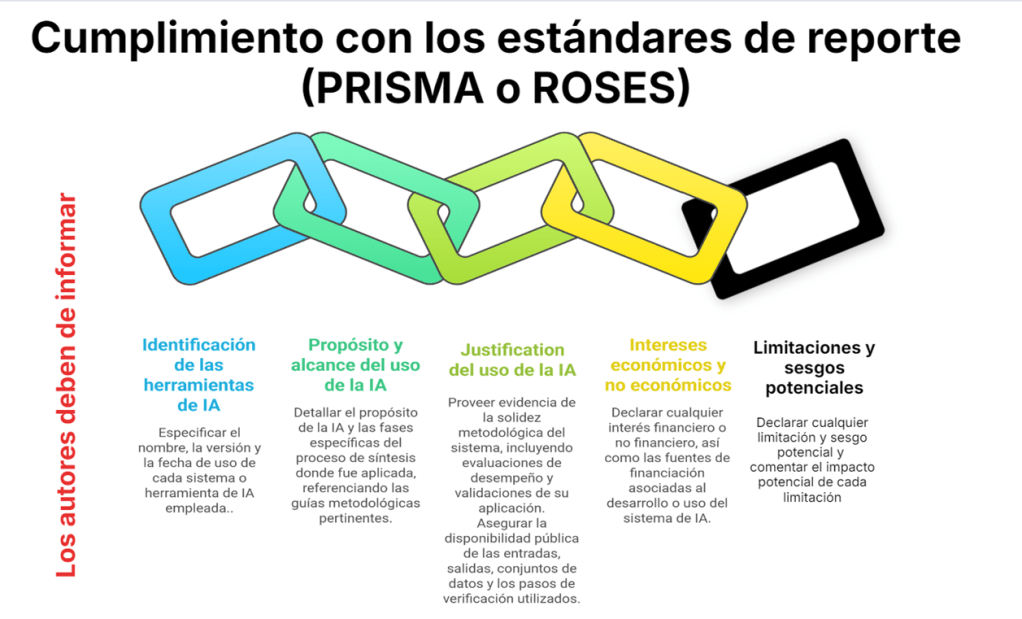

Incluye siempre:

- Nombre(s) del/de los sistema(s) o herramienta(s) de IA, versión(es) y fecha(s) de uso.

- Para qué la usaste y en qué fases; guía y cómo se aplicó (incluidas modificaciones).

- Justificación y evidencia de desempeño/limitaciones; cómo validaste/pilotaste su uso.

- Disponibilidad (si es viable): prompts, salidas, datasets, código; y pasos de verificación.

- Intereses (financieros/no financieros) respecto a la herramienta y su financiación.

- Limitaciones y sesgos detectados y su posible impacto.

Alinea con PRISMA/ROSES y colócalo donde pida la revista (Métodos, Agradecimientos o sección específica).

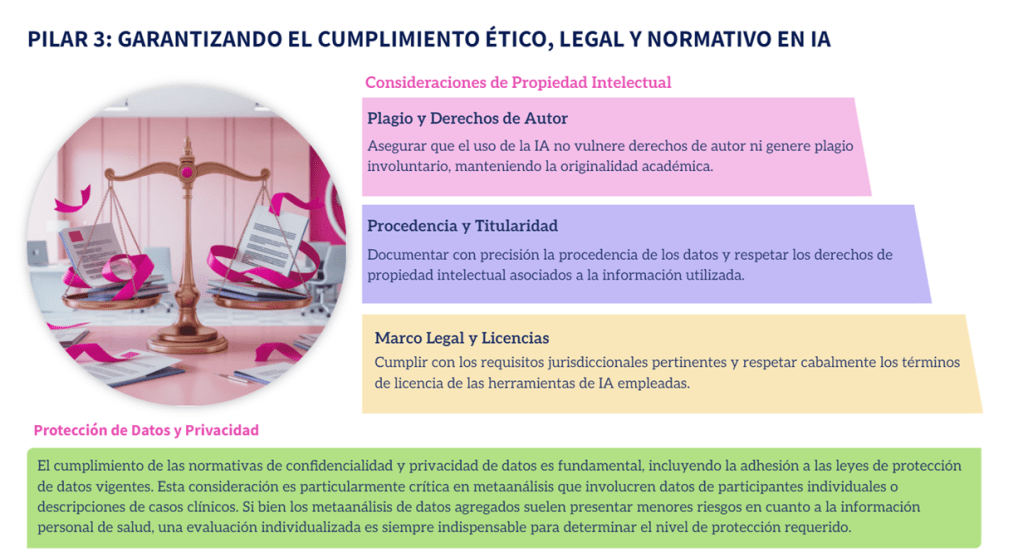

PILAR 3. Consideraciones éticas y legales.

Cuida plagio, autoría, derechos y licencias, confidencialidad y protección de datos. Si tratas datos sensibles, extrema las garantías.

Plantilla para declarar el uso de IA (copiar/pegar)

Aquí te dejo un ejemplo de modelo de plantilla que puedes utilizar en tu próxima revisión:

Uso de IA y automatización: Durante esta revisión utilizamos [Nombre-herramienta, versión] (acceso el [fecha]) para [fases: búsqueda/cribado/extracción/síntesis/resumen]. Aplicamos [parámetros/modificaciones] y validamos su desempeño mediante [piloto, muestreo, doble ciego, comparación con estándar]. Conservamos prompts, salidas y registros en [repositorio/suplemento]. El equipo no declara [intereses/relaciones] con el proveedor. Limitaciones observadas: [listar]; impacto potencial: [describir]. La decisión final sobre elegibilidad, extracción y conclusiones fue humana.

Tabla traducida al español de RAISE (versión 2.1 en desarrollo a partir del 22 de septiembre de 2025)

| Categoría RISE | Más orientación |

|---|---|

| Mantener la responsabilidad última de la síntesis de evidencia | – El autor es responsable del contenido, los métodos y los hallazgos de su síntesis de evidencia, incluida la decisión de usar IA, cómo se usa y su impacto en la síntesis. – Al considerar el uso de un sistema o herramienta de IA, sea crítico con sus evaluaciones para comprender si hace lo que declara con un nivel adecuado, así como sus limitaciones y si puede aplicarse al contexto de la síntesis específica. – El uso de la IA debe estar justificado y debe demostrarse que las herramientas son metodológicamente sólidas, que no socavan la confiabilidad o fiabilidad de la síntesis ni de sus conclusiones y que es apropiado usar un sistema o herramienta de IA específica en el contexto de la síntesis concreta. |

| Informar de manera transparente el uso de IA en el manuscrito de la síntesis de evidencia | – Los autores pueden utilizar IA dentro de sus síntesis y para preparar su manuscrito. – Los autores deben declarar cuándo han utilizado IA si esta realiza o sugiere juicios, por ejemplo en relación con la elegibilidad de un estudio, valoraciones (incluida la evaluación del riesgo de sesgo), extracción de datos bibliográficos, numéricos o cualitativos de un estudio o de sus resultados, síntesis de datos de dos o más estudios, valoración de la certeza de la evidencia (incluidos los dominios de GRADE o las calificaciones globales de certeza para un desenlace o hallazgo), redacción de texto que resume la solidez global de la evidencia, las implicaciones para la toma de decisiones o la investigación, o resúmenes en lenguaje sencillo. En general, no es necesario consignar la IA utilizada únicamente para mejorar ortografía, gramática o la estructura del manuscrito, pero recomendamos comprobar la política específica de la revista para asegurar el cumplimiento. – Cumplir con los estándares de notificación establecidos por cada revista, como PRISMA o ROSES. PRISMA, por ejemplo, incluye ítems sobre la notificación de herramientas de automatización usadas en diferentes etapas del proceso de síntesis. Esto debe informarse en la sección especificada por cada revista, como Agradecimientos, Métodos o una sección específica para la divulgación del uso de IA. Si los detalles son extensos o la IA se usa en múltiples etapas, considere materiales suplementarios o una presentación tabular (o ambos). En general, los autores deben informar de lo siguiente: a) Nombre(s) del/de los sistema(s), herramienta(s) o plataforma(s) de IA, versión(es) y fecha(s) de uso. b) El propósito del uso de IA y qué partes del proceso de síntesis de evidencia se vieron afectadas. Citar o referenciar la guía de uso o describir cómo se empleó la IA, incluidas las modificaciones aplicadas. c) La justificación para usar IA, incluida la evidencia de que el sistema o herramienta de IA es metodológicamente sólida y no socavará la confianza o la fiabilidad de la síntesis o de sus conclusiones (p. ej., citando o referenciando evaluaciones de desempeño que detallen el impacto de errores, limitaciones y generalización), y cómo se ha validado (y pilotado, si procede) para asegurar que es apropiada en el contexto de la síntesis específica. Siempre que sea posible y práctico, poner a disposición pública y gratuita las entradas (p. ej., desarrollo de prompts), salidas, conjuntos de datos y código (por ejemplo, en repositorios o como materiales suplementarios) y describir los pasos seguidos para verificar las salidas generadas por IA. d) Cualesquiera intereses financieros y no financieros de los autores de la síntesis respecto del sistema o herramienta de IA, junto con las fuentes de financiación del propio sistema o herramienta de IA. e) Cualesquiera limitaciones del uso de IA en los procesos de la revisión, incluidos sesgos potenciales. Comentar el impacto potencial de cada limitación. |

| Garantizar el cumplimiento de estándares éticos, legales y normativos al usar IA | Asegúrese de cumplir los estándares éticos, legales y normativos al aplicar IA en su síntesis. Por ejemplo, tenga en cuenta cuestiones relacionadas con plagio, procedencia, derechos de autor, propiedad intelectual, jurisdicción y licencias; y con la confidencialidad, el cumplimiento normativo y las responsabilidades de privacidad, incluidas las leyes de protección de datos. |

Conclusión

RAISE no frena la innovación: la encauza. La guía RISE establece un hito esencial en la evolución de la síntesis de evidencia científica. Al definir principios claros para el empleo responsable de la inteligencia artificial, RISE no pretende restringir la innovación, sino orientarla para preservar y robustecer los valores intrínsecos de la investigación rigurosa.

El futuro de la síntesis de evidencia será, ineludiblemente, más automatizado. No obstante, con RISE como pauta, será también más responsable, transparente y fiable. Los investigadores que adopten estos principios no solo utilizarán herramientas poderosas de forma ética, sino que contribuirán a edificar un ecosistema de investigación más sólido y digno de confianza para las generaciones futuras.

Bibliografía

- Flemyng E., Noel-Storr A., Macura B., Gartlehner G., Thomas J., Meerpohl JJ., et al. Position statement on artificial intelligence (AI) use in evidence synthesis across Cochrane, the Campbell Collaboration, JBI and the Collaboration for Environmental Evidence 2025. Environ Evid. 2025;14(1):20, s13750-025-00374-5, doi: 10.1186/s13750-025-00374-5.

- Thomas J, Flemyng E, Noel-Storr A, Moy W, Marshall IJ, Hajji R, et al. Responsible use of AI in evidence SynthEsis (RAISE) 1: recommendations for practice. In: Open Science Framework, Washington DC: Center for Open Science. https ://doi.org/10.17605/OSF.IO/FWAUD. https://osf.io/.

[…] RAISE: cómo usar IA en síntesis de evidencia sin perder el rigor. […]

Me gustaMe gusta

[…] resumen (recuerda las pautas RAISE) […]

Me gustaMe gusta