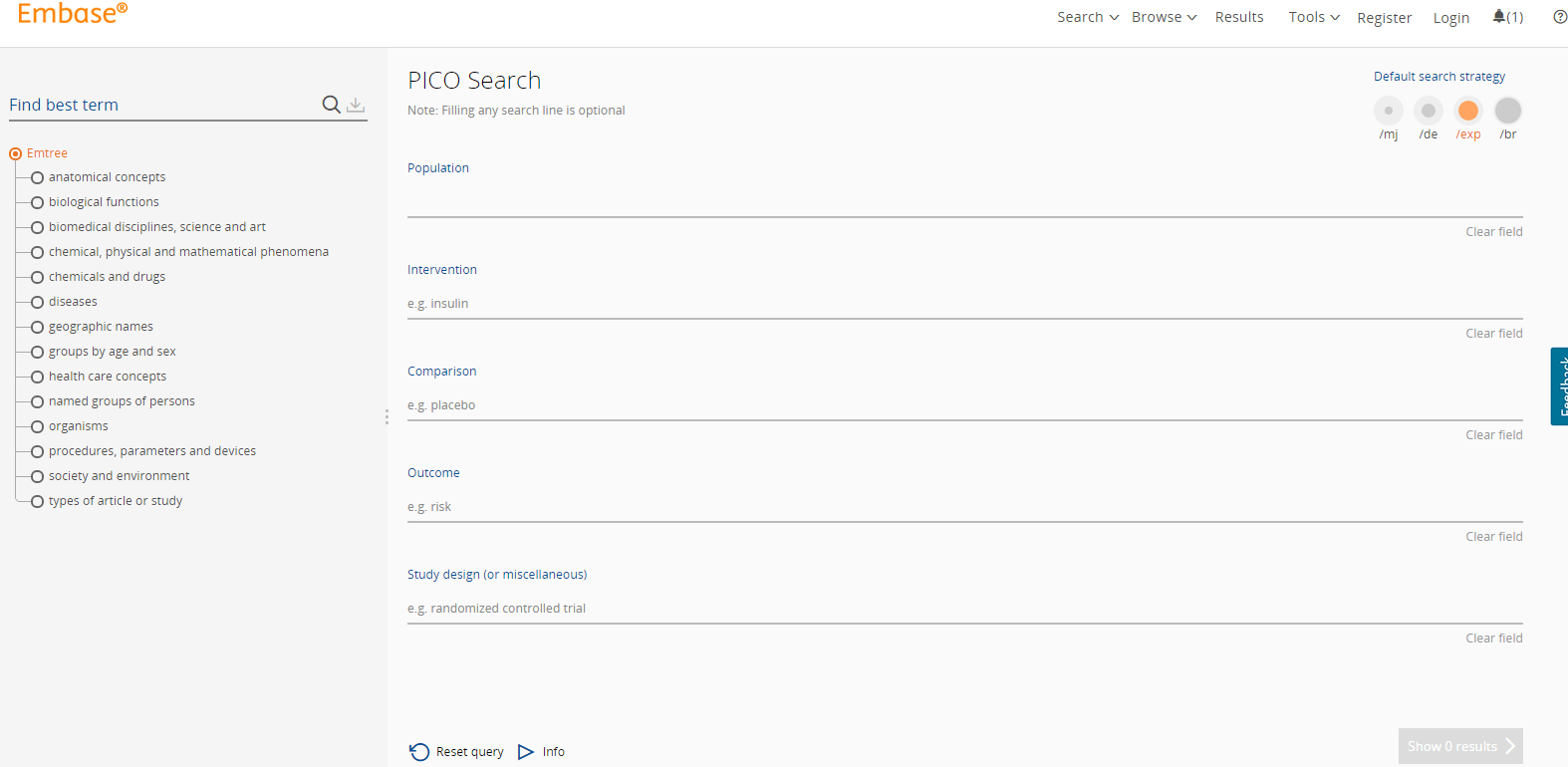

Para acotar el resultado de búsqueda, las bases de datos nos proporcionan diferentes recursos de filtrado con límites. Con ellos podemos excluir idiomas que no entendemos, buscar artículos que han sido publicados en cierto periodo de tiempo, recuperar artículos referentes a una población específica o buscar sólo determinados tipos de estudio o grupos de edad. Podemos limitar nuestro resultado a artículos publicados en revistas de enfermería seleccionado «Nursing Journals» dentro de la categoría de límite «Journal Categories» o directamente añadiendo a nuestra estrategia de búsqueda jsubsetn[text] (p. ej.: “Diabetes AND jsubsetn[text]”).

También disponemos de los filtros metodológicos o filtros de búsqueda («hedges«) de los que ya hablé extensamente en una entrada anterior (https://ccamposhugf.wordpress.com/2013/08/22/que-son-los-filtros-de-busqueda/). Son estrategias de búsquedas desarrolladas y validadas para utilizar en bases de datos electrónicas que nos ayudan a perfeccionar la estrategia de búsqueda para recuperar estudios científicamente sólidos y clínicamente relevantes, por ejemplo, estudios diseñados para responder preguntas relacionadas con la efectividad de una terapia o la precisión de una prueba de diagnóstica. Estas estrategias prediseñadas se han de combinar con el término/s o descriptor/es de lo que deseamos buscar permitiéndonos una recuperación de la información con un alto grado de exactitud. En la página del Centre for Reviews and Dissemination (The InterTASC Information Specialists’ Sub-Group Search Filter Resource) podemos encontrar una recopilación de diferentes filtros para diversas bases de datos y plataformas (1). El desarrollo de filtros de búsqueda para la profesión de enfermería es limitado y se ha centrado en aspectos específicos del cuidado de enfermería (2-4).

Por último, recordar que en PubMed podemos guardar nuestros filtros creando y personalizando una cuenta MyNCBI tal como contamos en una anterior entrada de BiblioGETAFE (https://ccamposhugf.wordpress.com/2013/11/26/como-crearnos-una-cuenta-personal-en-pubmed-myncbi/).

Bibliografía:

- ISSG Search Filter Resource [Internet]. Glanville J, Lefebvre C, Wright K, editors. York (UK): The InterTASC Information Specialists’ Sub-Group; 2008 [actualizado 26 Febrero 2018; consultado el 8 mayo 2018]. Disponible en: https://sites.google.com/a/york.ac.uk/issg-search-filters-resource/home

- Berg A, Fleischer S, Behrens J. Development of two search strategies for literature in MEDLINE-PubMed: nursing diagnoses in the context of evidence-based nursing. Int J Nurs Terminol Classif. 2005 Apr;16(2):26–32.

- Lavin MA, Krieger MM, Meyer GA, Spasser MA, Cvitan T, Reese CG, Carlson JH, Perry AG, McNary P. Development and evaluation of evidence-based nursing (EBN) filters and related databases. J Med Lib Assoc. 2005 Jan;93(1):104–15.

- Simon M, Hausner E, Klaus SF, Dunton NE. Identifying nurse staffing research in MEDLINE: development and testing of empirically derived search strategies with the PubMed interface. BMC Med Res Methodol. 2010 Aug 23;10:76.