Una de las preguntas que más se repiten hoy entre autores no es si pueden usar inteligencia artificial, sino para qué pueden usarla y cuando no deberían. La respuesta seria no cabe en un sí o en un no. No existe una autorización general para “usar IA” en un artículo. Lo que existe es un marco cada vez más aceptado: autoría humana, responsabilidad humana, transparencia cuando el uso es sustantivo y restricciones claras en ámbitos especialmente sensibles como imágenes, datos, confidencialidad y revisión por pares.

El framework interactivo de Lluís Codina (https://www.perplexity.ai/apps/9d81f4a2-97e6-4854-9443-d259f4ff3a01) resulta útil precisamente porque ordena ese terreno, aunque el propio autor recuerda que es una herramienta orientativa y que la norma aplicable en cada caso sigue siendo la de la revista, la editorial, la institución o el programa académico correspondiente.

Primera línea roja: autoría, responsabilidad y declaración de uso

La IA no puede figurar como autora. No puede asumir responsabilidad por el trabajo, no puede responder por la integridad del contenido y no puede aprobar la versión final del manuscrito. Esa responsabilidad sigue recayendo por completo en las personas firmantes. Dicho de otro modo: la IA puede ser una herramienta, pero no un sujeto autoral.

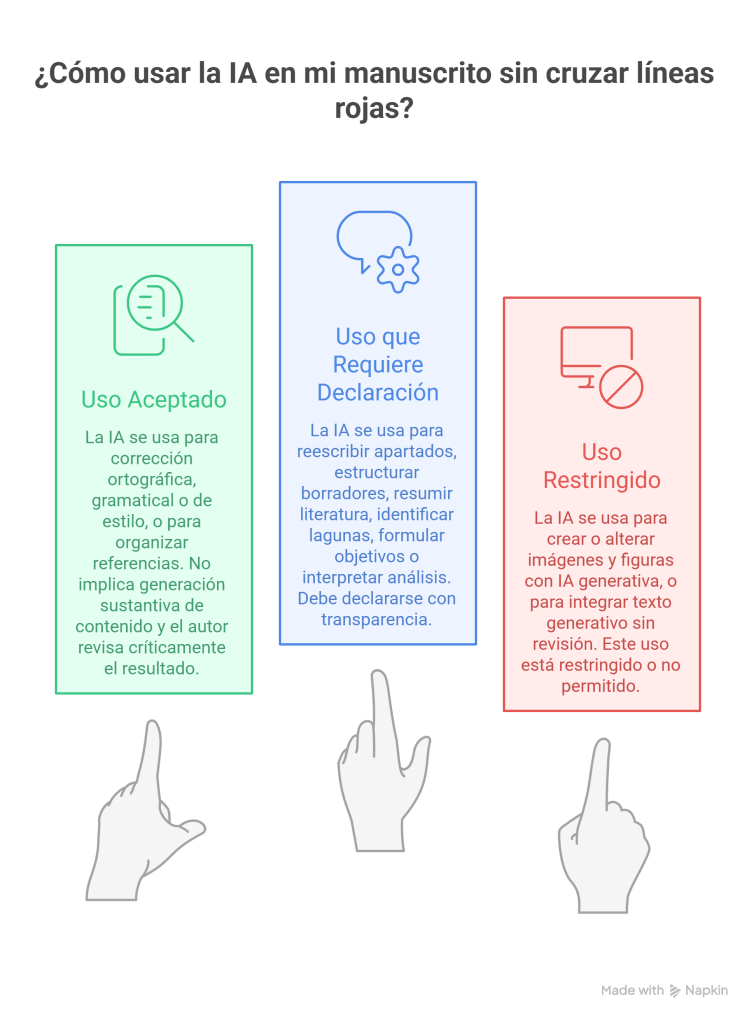

¿Y cuál si es un uso aceptado sin declaración formal? La corrección ortográfica, gramatical o de estilo, siempre que no impliquen generación sustantiva de contenido y que el autor revise críticamente el resultado. En ese mismo espacio se sitúan los gestores bibliográficos y herramientas equivalentes de apoyo, que ayudan a organizar referencias pero no producen por sí mismas el contenido intelectual del artículo.

El problema empieza cuando la IA deja de pulir la forma y empieza a influir de manera sustantiva en el contenido. Si se utiliza para reescribir apartados completos, estructurar borradores, resumir literatura de forma sustantiva, identificar lagunas, formular objetivos o hipótesis, interpretar análisis o intervenir de forma significativa en el proceso de investigación, el uso debe declararse con transparencia. Las recomendaciones europeas insisten en que, cuando la herramienta influye de manera significativa, debe explicarse qué herramienta se ha usado, con qué versión, para qué propósito y de qué modo ha afectado al proceso. Algunas editoriales piden además una declaración específica en el manuscrito; Elsevier, por ejemplo, la sitúa antes de las referencias, mientras que en otros entornos esa información puede ir en Métodos o en Agradecimientos.

Aquí conviene aclarar que declarar el uso de IA no convierte automáticamente ese uso en admisible. Hay intervenciones que muchas políticas editoriales restringen o directamente no permiten aunque el autor las reconozca. Es el caso de la creación o alteración de imágenes y figuras con IA generativa, salvo excepciones muy concretas en las que la IA forma parte del propio método de investigación y el proceso puede describirse de manera reproducible. También es una mala idea tratar la salida de un sistema generativo como si fuera texto original listo para integrarse sin más en el manuscrito. La IA puede inspirar, sugerir o ayudar a reformular, pero no sustituye la aportación intelectual auténtica del autor.

Segunda línea roja: integridad

Otra zona crítica es la integridad científica. Las directrices europeas son explícitas al señalar que no debe utilizarse IA para falsificar, alterar o manipular datos originales. Además, recuerdan que estos sistemas pueden producir sesgos, alucinaciones e incluso referencias inventadas, por lo que la verificación humana no es opcional, sino obligatoria. En realidad, el principio rector es bastante simple: cuanto más influye la herramienta en el contenido, más alta debe ser la exigencia de comprobación crítica.

Tercera línea roja: confidencialidad y propiedad intelectual

La confidencialidad y la propiedad intelectual merecen un apartado aparte. Subir a una herramienta externa un manuscrito inédito, datos sensibles, imágenes no publicadas, prompts con información protegida o materiales de terceros puede generar problemas serios de privacidad, reutilización no autorizada y pérdida de control sobre el contenido. Las recomendaciones europeas y varias editoriales insisten en revisar las condiciones de uso, comprobar si el contenido puede reutilizarse para entrenamiento y evitar la carga de materiales confidenciales en sistemas externos sin garantías adecuadas. Este punto es todavía más estricto en revisión por pares: tanto Springer Nature como Elsevier indican que los manuscritos sometidos a revisión no deben cargarse en herramientas generativas públicas por razones de confidencialidad, derechos de autor e integridad del proceso editorial.

Consejo práctico a los autores

Para un autor, una regla práctica útil sería esta. Si la herramienta solo mejora la expresión y no altera el contenido intelectual, probablemente estás en una zona relativamente segura. Si contribuye de forma sustantiva a redactar, organizar, interpretar o decidir, debes declararlo. Y si afecta a datos, imágenes, material inédito, confidencialidad o evaluación de trabajos ajenos, conviene detenerse y revisar con mucho cuidado la política de la revista antes de continuar. Es una cuestión de integridad, trazabilidad y responsabilidad académica.

Una fórmula razonable para muchos casos no es esconder el uso de IA ni convertirlo en un reclamo, sino describirlo con sobriedad cuando haya sido relevante: herramienta utilizada, finalidad concreta, grado de intervención y revisión humana posterior. La buena práctica consiste en mantener al autor dentro del proceso, con pensamiento crítico, control de la versión final y responsabilidad plena sobre cada afirmación, cada dato y cada referencia.

Bibliografía

Codina L. Cómo saber si un uso de la IA en trabajos académicos es legítimo: framework interactivo [desarrollado con Perplexity] [Internet]. 2026 Feb 13 [citado 18 mar 2026]. Disponible en: lluiscodina.com.

Codina L. Uso ético y eficiente de la inteligencia artificial en trabajos académicos: Veritas e interacción crítica escalonada. BiD. 2025;55. doi:10.1344/bid2025.55.01. Disponible en: https://www.raco.cat/index.php/BiD/article/view/980000003803.

European Commission, Directorate-General for Research and Innovation. Living guidelines on the responsible use of generative AI in research. 2nd ed. Brussels: European Commission; 2025. Disponioble en: https://research-and-innovation.ec.europa.eu/document/download/2b6cf7e5-36ac-41cb-aab5-0d32050143dc_en?filename=ec_rtd_ai-guidelines.pdf

Bhavsar D, Duffy L, Jo H, Lokker C, Haynes R, Iorio A, et al. Policies on artificial intelligence chatbots among academic publishers: a cross-sectional audit. Res Integr Peer Rev. 2025;10:1. doi:10.1186/s41073-025-00158-y. Disponible en: https://link.springer.com/article/10.1186/s41073-025-00158-y

Elsevier. Generative AI policies for journals [Internet]. 2025 [citado 18 mar 2026]. Disponible en: https://www.elsevier.com/about/policies-and-standards/generative-ai-policies-for-journals

Springer Nature. AI for our communities [Internet]. [citado 18 mar 2026]. Disponible en: https://group.springernature.com/gp/group/ai/ai-guidance-for-our-researchers-and-communities

Taylor & Francis. Images and figures: AI, Large Language Models (LLMs) and figures or images [Internet]. [citado 18 mar 2026]. Disponible en: https://authorservices.taylorandfrancis.com/editorial-policies/.